L’éducation fondée sur des preuves est souvent mal connue et mal comprise. Ce n’est pas une théorie de l’éducation, ni une politique éducative particulière. C’est juste l’application de la démarche scientifique usuelle aux questions relatives aux pratiques pédagogiques et aux politiques éducatives.

Conséquence de ces malentendus, de nombreuses personnes se sentent obligées de critiquer l’éducation fondée sur des preuves, et fournissent des arguments censés la réfuter. J’ai recensé 22 de ces arguments que j’ai régulièrement entendus, et je donne ci-dessous mes réponses. Par rapport au feuilleton que j’avais diffusé sur les réseaux sociaux, j’ai réorganisé ces arguments dans un ordre plus logique, en les séparant en 4 catégories :

- Arguments de nature scientifique et méthodologique :

- Des méthodes conçues pour la médecine ne peuvent pas s’appliquer à l’éducation;

- La méthode expérimentale comporte des biais;

- L’éducation fondée sur des preuves ne peut s’appliquer qu’à des pédagogies standardisées;

- L’éducation fondée sur des preuves ne s’intéresse qu’à ce qui est mesurable et quantifiable;

- L’éducation fondée sur des preuves ne s’intéresse qu’à la performance scolaire;

- Les méthodes expérimentales ne permettent d’établir que des « effets moyens », ce qui est d’un intérêt limité en pédagogie;

- En pédagogie, isoler strictement une variable n’est pas possible;

- Comment prétendre sérieusement promouvoir des « méthodes efficaces » en les détachant des conditions concrètes (nombres d’élèves, inégalités sociales, etc.) dans lesquelles elles devraient être mises en œuvre ?

- On enseigne à des enfants, pas à des sujets. C’est la qualité des relations humaines qui est primordiale;

- Ces recherches en laboratoire ne peuvent prescrire ce qu’il faut faire en classe;

- Rien de nouveau sous le soleil.

- Arguments épistémologiques :

- Arguments concernant la mise en œuvre :

- La singularité des contextes, des élèves… empêche toute mise en place de pratique fondée sur les données probantes;

- Les politiques éducatives échouent souvent à atteindre leurs objectifs, même quand elles sont fondées sur des preuves scientifiques;

- Les enseignants doivent faire chaque jour des choix pédagogiques qui n’ont pas été testés scientifiquement, sans attendre les résultats des études;

- Arguments éthiques, politiques et idéologiques:

- Il n’est pas éthique de procéder à des expérimentations en éducation, les élèves ne sont pas des cobayes;

- L’éducation fondée sur des preuves évacue la question des valeurs;

- Vouloir évaluer l’efficacité en éducation, c’est du néolibéralisme;

- L’éducation fondée sur des preuves prend les enseignants pour des robots décervelés ou des techniciens;

- L’éducation fondée sur des preuves veut formater les élèves, en faire de bons petits travailleurs dociles;

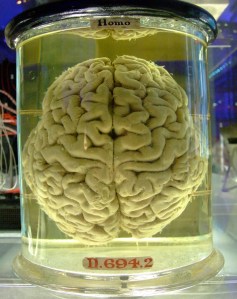

- Ces recherches réduisent les enfants à leur cerveau. On enseigne à des enfants, pas à des cerveaux;

- Promouvoir l’éducation fondée sur des preuves c’est entretenir le soupçon sur la façon dont les personnels font leur métier.

A. Arguments de nature scientifique et méthodologique

1. Des méthodes conçues pour la médecine ne peuvent pas s’appliquer à l’éducation

C’est une pétition de principe. En fait c’est parfaitement possible. La méthode de l’essai randomisé contrôlé nécessite uniquement de pouvoir comparer 2 groupes recevant des interventions différentes, et de mesurer ce que l’intervention vise à changer avant et après celle-ci. C’est donc totalement indépendant de la nature de l’intervention menée entre les deux temps de mesure. C’est pour cela que cette méthode a produit des résultats pertinents pour l’évaluation des traitements médicaux, paramédicaux, des psychothérapies, des pratiques pédagogiques, et des politiques publiques dans les domaines de l’éducation, de la santé, du handicap, des affaires sociales, de la lutte contre la pauvreté, de l’emploi, de la lutte contre la criminalité, de la justice, etc. On peut s’en faire une idée en constatant l’étendue et la qualité du travail des What Works Centres britanniques.

2. La méthode expérimentale comporte des biais

Non, la méthode expérimentale n’a pas intrinsèquement de biais. Toute étude, qu’elle soit expérimentale ou non, peut comporter des biais. Surtout les études non-expérimentales ! Dans les études observationnelles, de nombreux facteurs sont confondus les uns avec les autres, par exemple : l’action pédagogique du prof, ses autres qualités, les caractéristiques de ses élèves, ce que ses élèves apprennent en-dehors de la classe, etc. Lorsque l’on croit observer un effet de l’action pédagogique, il se peut qu’on observe en fait l’effet d’un autre facteur : l’observation est biaisée. Ce qui fait qu’il est impossible de démêler les différents facteurs et de tirer une conclusion fiable quant à l’effet causal du facteur d’intérêt. C’est précisément pour cela qu’on a inventé la méthode expérimentale, pour minimiser les biais inhérents aux études observationnelles ! L’utilisation de grands effectifs et le tirage au sort des participants entre les différents groupes est particulièrement de nature à produire des estimations moins biaisées que les autres méthodes. Cela n’implique pas qu’une étude expérimentale soit toujours exempte de biais. Elle peut toujours en avoir, aucune étude n’est parfaite. Mais elle en aura toujours moins qu’une étude observationnelle portant sur le même facteur.

NB : il existe des méthodes sophistiquées (de type économétrique) pour modéliser des relations causales dans des données purement observationnelles. Ce sont des compléments importants à la méthode expérimentale, et parfois la seule possibilité (lorsque l’expérimentation n’est pas possible). Mais ce ne sont généralement pas des méthodes utilisées par les opposants à la méthode expérimentale.

3. L’éducation fondée sur des preuves ne peut s’appliquer qu’à des pédagogies standardisées

Non. Pour évaluer des pratiques pédagogiques, il suffit que ces pratiques soient caractérisées de manière suffisamment précise, pour qu’on soit en mesure de distinguer une pédagogie A d’une pédagogie B, et de définir des programmes de formation à la pédagogie A ou B. Cela n’implique pas que ces pédagogies soient totalement rigides, appliquées à l’identique par tous les enseignants à tous les apprenants, sans aucun degré de liberté. Certaines pédagogies (tout comme les psychothérapies) peuvent offrir de la souplesse et des possibilités d’adaptation, tout en étant bien caractérisées et distinguables d’autres pédagogies. Du moment qu’elles sont bien caractérisées, cela suffit à faire des groupes d’enseignants pratiquant les pédagogies A, B ou X, et à en comparer les effets sur leurs élèves.

Ce prérequis de l’éducation fondée sur des preuves s’applique en fait à tous ceux qui discourent sur l’éducation. En effet, caractériser précisément la pédagogie sur laquelle on affirme quelque chose, c’est tout simplement le minimum requis pour savoir de quoi on parle.

4. L’éducation fondée sur des preuves ne s’intéresse qu’à ce qui est mesurable et quantifiable

Certes. Mais ce n’est pas l’argument-massue que certains imaginent.

Pour évaluer des pratiques ou une politique, il faut nécessairement 1) définir précisément ce que ces pratiques visent à changer (par exemple une compétence scolaire, ou un ressenti subjectif) ; 2) trouver un moyen de mesurer cette dimension (par des tests, questionnaires ou observations) ; 3) afin de pouvoir la comparer avant et après une intervention, et entre différentes pratiques ou politiques. Pour effectuer de telles comparaisons, il est nécessaire que les mesures soient quantitatives ou puissent être converties sur une échelle numérique. La manière de quantifier toute mesure, y compris qualitative et subjective, est expliquée dans un précédent article sur l’évaluation de la souffrance psychique.

Plus généralement, il est difficile d’étudier rigoureusement ce qui n’est pas mesurable. Si on ne sait pas mesurer quelque chose, que peut-on en dire de précis ? Intéressons-nous donc à la position alternative. Quand certains disent dédaigneusement que l’éducation fondée sur des preuves ne s’intéresse qu’à ce qui est mesurable et quantifiable, ils disent implicitement « Nous, nous nous intéressons aux choses nobles, celles qui comptent vraiment en éducation, celles qui ne sont ni mesurables ni quantifiables ». Mais quelles sont donc ces choses nobles et mystérieuses, et que pouvez-vous en dire d’autre que des discours vagues et sans preuves ?

Dans bien des cas, ces personnes parlent de dimensions qui sont parfaitement mesurables et quantifiables. Peut-être ignorent-elles qu’elles le sont. Peut-être s’abstiennent-elles de les mesurer par principe. Dans tous les cas, on est en droit de leur demander des justifications : quelles données factuelles pouvez-vous montrer à l’appui de votre affirmation ? Pourquoi devrait-on croire ce que vous affirmez, si vous n’avez pas pris la peine de mesurer ce dont vous parlez ?

Dans d’autres cas, ces personnes parlent de dimensions qui sont très vagues et globales. Par exemple « émanciper les élèves » ou « former des citoyens libres et éclairés ». De manière générale, il est difficile d’étudier scientifiquement des concepts trop vagues et peu définis. L’approche scientifique exige justement de définir précisément les concepts. Néanmoins, efforçons-nous d’aller au bout de cette logique :

- Si l’on veut rigoureusement évaluer des pratiques qui visent ces dimensions, à défaut de pouvoir mesurer quelque chose d’aussi vague et mal défini, on peut tenter de l’opérationnaliser (en lui substituant un concept voisin moins vague et mieux défini), ou de le décomposer en concepts plus simples et précis qui, eux, sont mesurables. Par exemple, construire des tests, questionnaires ou grilles d’observation sondant différents aspects de ce que l’on entend par « émancipation » ou « citoyen libre et éclairé ». Si la pratique qu’on veut évaluer a un effet réel sur le concept vague et mal défini, elle devrait aussi en avoir sur ces mesures. C’est le mieux que l’on puisse faire.

- Si l’on refuse de décomposer et préciser le concept vague et mal défini, ou si c’est impossible, alors il serait prudent de ne rien affirmer à son sujet. Car comment pourrait-on justifier une telle affirmation ? A nouveau, on est en droit de demander des justifications : quelles données factuelles pouvez-vous montrer à l’appui de votre affirmation ? Pourquoi devrait-on croire ce que vous affirmez avec autant d’aplomb, si vous n’êtes pas capable de mesurer ce dont vous parlez, ni même de le définir de manière suffisamment précise pour qu’on puisse l’opérationnaliser et concevoir des outils de mesure ?

Dans tous les cas, on en revient à la nécessité pour tout chercheur de fournir des justifications convaincantes de ses énoncés. Sans mesures quantifiées, il est difficile de produire des justifications convaincantes sur des questions d’efficacité.

A propos des données qualitatives

Beaucoup de personnes revendiquent l’étude de données qualitatives en éducation. En fait, une fois que l’on a bien exploré et décrit les dimensions pertinentes des données qualitatives, il est souvent possible de les convertir sur des échelles numériques, afin de faire plus précisément les comparaisons requises.

Les données qualitatives sont utiles surtout quand on ne sait pas exactement ce qu’on cherche, alors on fait du descriptif et de l’exploratoire : on enregistre tout ce qu’on voit et tout ce que les gens disent. Ça peut faire émerger des hypothèses intéressantes sur des facteurs pertinents. Une fois que des hypothèses précises sont formulées, on peut concevoir des mesures plus spécifiques et quantitatives de ces facteurs pertinents et tester des hypothèses précises quant à leurs effets. Alors qu’avec des données qualitatives, on peut discourir sur leurs effets supposés mais on ne peut pas rigoureusement tester ces hypothèses.

5. L’éducation fondée sur des preuves ne s’intéresse qu’à la performance scolaire

Non. L’éducation fondée sur des preuves s’intéresse à toutes les questions que se posent les enseignants, les parents, les politiques, et les chercheurs. Bien sûr, dans le domaine scolaire, beaucoup de questions légitimes ont trait à la performance scolaire : comment enseigner au mieux la lecture ? comment faire progresser la compréhension des fractions par les élèves ? Mais il y en a bien d’autres : comment augmenter l’engagement des élèves dans les apprentissages ? comment établir un climat de classe positif et diminuer les comportements perturbateurs ? comment améliorer le bien-être des élèves ? et celui des enseignants ? Il est possible de répondre rigoureusement à toutes ces questions. La seule condition nécessaire est de posséder ou de concevoir des outils de mesure (tests, questionnaires ou échelles d’observation) de ce que l’on cherche à améliorer. On en revient donc au point précédent. A partir de là, il est possible de le mesurer avant et après une intervention, et d’en comparer les progrès entre différents groupes recevant différentes interventions. Cette démarche scientifique n’est donc en aucun cas limitée à la performance scolaire.

6. Les méthodes expérimentales ne permettent d’établir que des « effets moyens », ce qui est d’un intérêt limité en pédagogie

Les méthodes expérimentales permettent effectivement de déterminer des effets moyens ainsi que la variabilité autour de l’effet moyen. C’est d’un grand intérêt pédagogique. En effet, il est fort possible que différentes pédagogies conviennent à différents enfants. Mais dans un contexte où l’enseignant enseigne en classe entière et ne peut totalement individualiser son enseignement, il parait raisonnable, en première approche, de choisir des pédagogies qui produisent le plus grand effet moyen, c’est-à-dire qui conviennent au plus grand nombre d’enfants.

Si l’on soupçonne que certains élèves n’apprennent pas bien avec la « pédagogie de la moyenne », on peut essayer d’en identifier les caractéristiques (par exemple niveau socio-économique, ou troubles des apprentissages), et envisager d’autres pédagogies qui leur conviendraient mieux. Mais à nouveau, il s’agit d’hypothèses à tester, et elles le seront le mieux avec la méthode expérimentale.

Par ailleurs, si l’on dispose de nombreuses études expérimentales sur un même sujet, les méta-analyses permettent d’étudier de manière systématique les « modérateurs » de l’effet, c’est-à-dire les facteurs qui le font varier. D’ailleurs, le « Teaching and learning toolkit » de l’Education Endowment Foundation inclut systématiquement une section « derrière la moyenne » qui donne des indications sur les facteurs qui peuvent faire varier un effet autour de la moyenne.

On peut ainsi en arriver à proposer aux enseignants une démarche rationnelle incluant:

- Une pédagogie qui est la meilleure pour la plupart des élèves ;

- une pédagogie alternative qui est la meilleure pour ceux qui ne bénéficient pas suffisamment de la première ;

- si nécessaire on peut encore tester d’autres pédagogies plus adaptées à ceux qui ne répondraient pas assez aux deux premières, et qui pourraient être mises en œuvre par des enseignants spécialisés

- une démarche rationnelle permettant ainsi à l’enseignant de différencier sa pédagogie pour gérer la diversité dans sa classe sans pour autant devoir individualiser son enseignement ;

- le tout fondé sur des preuves d’efficacité, parce que c’est toujours mieux que des allégations.

C’est compliqué, bien sûr, mais ça existe, c’est par exemple la démarche de l’approche « réponse à l’intervention » pour l’apprentissage de la lecture.

Enfin, il est important de retourner la question à ceux qui la posent : vous critiquez la méthode expérimentale, mais quelles pédagogies proposez-vous, vous, pour gérer la diversité dans la classe ? Et comment savez-vous si elles sont efficaces, si elles n’ont pas été testées par la méthode expérimentale ?

7. En pédagogie, isoler strictement une variable n’est pas possible

C’est une pétition de principe. Certaines variables pédagogiques s’isolent très bien, d’autres moins, mais ce n’est pas toujours crucial. On peut aussi bien comparer les effets de micro-pratiques pédagogiques que ceux d’approches plus globales différant par de nombreux aspects.

Que l’on compare les enseignants de CP utilisant un manuel de lecture phonique ou non-phonique, ou qu’on les compare selon le nombre de correspondances graphèmes-phonèmes enseignées au cours du trimestre, il n’est pas indispensable que les groupes comparés soient parfaitement homogènes, que tous les enseignants suivent une méthode à la lettre, du moment que les deux groupes diffèrent globalement selon une ou plusieurs dimensions identifiées. La variabilité au sein des deux groupes introduit du bruit statistique dans la comparaison, mais beaucoup d’effets pédagogiques peuvent être mis en évidence malgré ce bruit. Cela a par exemple été abondamment démontré dans le cas de l’enseignement de la lecture :

Il existe tout de même un sens dans lequel l’idée d’« isoler une variable » a son importance. On peut en effet s’inquiéter du fait que les progrès que l’on mesure ne sont pas juste liés à la pratique pédagogique d’intérêt, mais peuvent être dus à d’autres facteurs corrélés : il se pourrait par exemple que les enseignants qui choisissent spontanément d’utiliser un manuel phonique et d’enseigner de nombreuses correspondances graphèmes-phonèmes ont d’autres qualités particulières, et que ce soient ces qualités qui font progresser leurs élèves en lecture, plutôt que la méthode choisie.

Cette problématique des facteurs potentiellement confondus est l’un des grands enjeux de la recherche en sciences sociales et en particulier en éducation. Et c’est précisément pour cela que toutes les méthodes ne se valent pas. La meilleure manière de neutraliser tous les facteurs potentiellement confondus est d’utiliser l’essai randomisé contrôlé : en tirant au sort un grand nombre d’enseignants volontaires entre ceux qui recevront une formation à une méthode phonique et ceux qui recevront une formation à une méthode non-phonique, les autres qualités de ces enseignants seront réparties aléatoirement entre les deux groupes, et découplées des pratiques que l’on évalue. Aucune autre méthode, expérimentale non aléatoire, ou observationnelle, n’a cette qualité.

L’expérimentation sur de grands effectifs et le tirage aléatoire sont donc les meilleurs moyens méthodologiques pour contrôler les facteurs confondus et ainsi isoler les variables d’intérêt, en pédagogie comme dans tous les autres domaines.

8. Comment prétendre sérieusement promouvoir des « méthodes efficaces » en les détachant des conditions concrètes (nombres d’élèves, inégalités sociales, etc.) dans lesquelles elles devraient être mises en œuvre ?

L’éducation fondée sur des preuves ne se désintéresse aucunement des conditions d’enseignement, au contraire, elle en fournit des évaluations. Par exemple on peut trouver sur le site de l’EEF une estimation de l’effet de la réduction de la taille des classes sur les apprentissages.

Et il existe bien sûr d’innombrables études sur les effets des inégalités sociales, qui sont par exemple systématiquement détaillées dans toutes les notes de la DEPP et dans toutes les études de l’OCDE.

Si au cours de l’évaluation d’une pratique pédagogique ou d’une politique éducative, on a des raisons de penser que ses effets pourraient varier en fonction des effectifs, du milieu social, ou de tout autre facteur, alors c’est une hypothèse qu’il est possible de tester, de manière expérimentale dans de nouvelles études, ou par des analyses de modérateurs dans les méta-analyses.

En résumé, il est très pertinent de se soucier des conditions précises dans lesquelles l’effet d’une politique ou d’une pratique peut être obtenu. Et le cadre de l’éducation fondée sur des preuves fournit toute la méthodologie nécessaire pour les déterminer. Quelle autre méthodologie le permettrait ?

9. On enseigne à des enfants, pas à des sujets. C’est la qualité des relations humaines qui est primordiale.

Tout le monde est convaincu que la qualité des relations entre élèves et enseignants est importante. Mais ce n’est pas un argument contre l’éducation fondée sur des preuves, bien au contraire !

Car une fois qu’on a énoncé ce slogan bien intentionné et un peu vague, on n’a rien dit qui puisse aider très concrètement les enseignants. Si on pense que c’est un facteur important, il faut faire le travail jusqu’au bout: définir des pratiques concrètes qui promeuvent les bonnes relations entre enseignant et élèves, puis les tester! C’est-à-dire vérifier expérimentalement si ces pratiques ont bien l’effet attendu sur la qualité des relations, et aussi si cet effet se transfère jusqu’aux résultats scolaires! C’est important car de manière générale les bonnes intentions ne suffisent pas.

Et bien sûr de telles recherches se font déjà. J’en donne un exemple ici:

Et un autre exemple là:

10. Ces recherches en laboratoire ne peuvent prescrire ce qu’il faut faire en classe

Cette objection reflète une représentation erronée de ce qu’est la recherche en éducation, qui ne se déroule pas en laboratoire.

Les recherches qui se font le plus souvent en laboratoire sont certaines recherches en psychologie qui visent à établir des résultats fondamentaux sur les processus cognitifs (tel que l’effet de récupération en mémoire), et bien sûr les recherches en neurosciences qui visent à comprendre les bases cérébrales des processus cognitifs. Mais ce n’est pas sur la base de ces recherches que l’on peut faire des recommandations fondées sur des preuves en éducation.

L’éducation fondée sur des preuves se base, bien évidemment, sur des recherches qui ont expérimenté des politiques éducatives ou des pratiques pédagogiques avec de vrais enseignants dans de vraies classes avec de vrais élèves. Même lorsque des interventions sont inspirées de résultats obtenus en laboratoire, elles sont ensuite testées dans des classes en situation réelle. Par exemple, l’exploitation pédagogique de l’effet de récupération en mémoire a été testée par des enseignants dans leurs classes (par exemple dans cette étude), et ce n’est bien sûr qu’à cette condition que l’on peut en tirer des recommandations valides.

11. Rien de nouveau sous le soleil

Lorsque les résultats de recherches expérimentales en éducation contredisent ce que vous croyez vrai (ou efficace), la tentation est grande de les rejeter, sous un prétexte ou sous un autre (l’un des 21 autres arguments de cette liste).

Mais il peut aussi arriver que des résultats de recherche confirment ce que vous croyiez vrai ou efficace. Et dans ce cas, qu’entend-on souvent de la part des détracteurs de l’éducation fondée sur des preuves ? « Rien de nouveau sous le soleil, on le savait déjà, on fait déjà tout ça. C’est bien la peine de payer des chercheurs pour inventer la machine à courber les bananes ! »

L’erreur de cet argument, c’est de croire déjà savoir ce qui est vrai ou efficace, avant même d’avoir pris connaissance des recherches sur le sujet. Et de faire plus confiance à son intuition ou à son expérience subjective qu’à des résultats objectifs. C’est confondre croyance et connaissance.

En fait, que des résultats de recherches confirment ou contredisent vos croyances, ils sont tout aussi importants ! Car avant que la recherche ne soit faite, rien n’est connu avec le même niveau de preuve, quelle que soit la force de votre conviction.

La science n’est pas un supermarché dans lequel on peut choisir les résultats qui vous conviennent, et laisser ceux qui ne vous conviennent pas. Si l’on pense que la démarche scientifique est la manière la plus fiable d’acquérir des connaissances sur le monde, alors il faut en prendre l’ensemble des résultats fiables, qu’ils vous plaisent ou pas.

B. Arguments épistémologiques

12. L’éducation fondée sur des preuves a une conception trop étroite de la notion de preuve

C’est sans aucun doute le cœur du débat. Qu’est-ce qui compte comme une preuve (ou plus modestement, une donnée convaincante) de l’efficacité d’une politique éducative ou d’une pratique pédagogique ?

Contrairement aux idées reçues, l’éducation fondée sur des preuves prend en compte l’ensemble des données disponibles : descriptives et explicatives, qualitatives et quantitatives, observationnelles et expérimentales.

En revanche, elle établit une hiérarchie entre les différents types de données, de la moins convaincante à la plus convaincante. C’est la hiérarchie des niveaux de preuve, parfois représentée sous forme d’une pyramide :

Cette hiérarchie est contestée pour défendre une pluralité de méthodologies qui seraient toutes de valeur égale. La diversité n’est pas un problème, mais peut-on raisonnablement défendre que toutes les méthodes se valent, et que toutes les données sont également convaincantes ? Ce serait nier plusieurs siècles d’histoire des sciences, au cours desquels les chercheurs n’ont cessé ne découvrir les limites de leurs données, les problèmes de leurs méthodes, et de continuellement améliorer leurs méthodologies de manière à produire des données toujours plus fiables permettant de tirer des conclusions toujours plus sûres. Peut-on raisonnablement défendre que la recherche en éducation soit immunisée contre ces problèmes et se tienne à l’écart de ces progrès méthodologiques ?

Contrairement à ce qu’en disent les détracteurs, la hiérarchie des niveaux de preuves n’a rien d’arbitraire. Elle est au contraire très rigoureusement justifiée par la nécessité de prendre en compte les multiples interprétations possibles d’un résultat produit par une méthode donnée, ainsi qu’il est détaillé dans cet article.

On peut bien sûr être en désaccord avec ces justifications. Mais dans ce cas il faut aller jusqu’au bout de l’argument, et expliquer précisément comment une autre méthodologie peut permettre de rejeter aussi bien les interprétations alternatives des mêmes observations.

13. L’éducation fondée sur des preuves s’appuie sur une épistémologie particulière, il y en a d’autres tout aussi valables

L’appel à une épistémologie alternative est une constante chez tous ceux qui veulent affirmer des choses sans apporter de preuves, ou qui veulent exercer sans avoir à justifier de l’efficacité de leurs pratiques. Il est par exemple abondamment utilisé par les promoteurs de pseudomédecines. Cela n’implique pas nécessairement qu’un tel argument soit illégitime, mais cela invite à le considérer avec un minimum de scepticisme.

Restons ouverts à l’idée qu’une épistémologie alternative ait quelque chose d’intéressant à apporter. Pour pouvoir en juger, il suffirait que quelqu’un explicite quelle est cette épistémologie alternative, comment elle fonctionne, comment elle valide les énoncés qui sont jugés vrais et comment elle valide les pratiques qui sont jugées efficaces. Et qu’on nous fournisse quelques exemples d’énoncés et de pratiques éducatives validées par cette épistémologie, et des données prises en compte pour les valider. Cela permettrait d’engager un débat fructueux sur la nature des données, leurs différentes interprétations possibles, et sur les atouts et les limites de chaque méthodologie.

En particulier, il serait intéressant que les partisans d’épistémologies alternatives répondent eux-mêmes aux critiques adressés à l’éducation fondée sur des preuves, qui peuvent aussi bien être retournées vers les autres approches. Par exemple :

- si vous pensez que la méthode expérimentale est biaisée (argument #2), comment votre épistémologie permet-elle de produire des résultats moins biaisés ?

- si vous reprochez à l’éducation fondée sur des preuves de ne s’intéresser qu’au mesurable et au quantifiable (argument #4), comment votre épistémologie permet-elle de produire des conclusions précises et fiables à propos de choses non mesurables et non quantifiables ?

- si vous pensez que l’éducation fondée sur des preuves ne parle que d’effets moyens (argument #6), comment votre épistémologie produit-elle des conclusions fiables sur les facteurs qui font varier les effets ?

- si vous pensez qu’isoler une variable n’est pas possible en pédagogie (argument #7), quels résultats concrets votre épistémologie permet-elle d’obtenir à propos de variables non dissociables les unes des autres ?

- si vous pensez qu’en pédagogie tout dépend de la singularité de chaque élève et de chaque contexte (argument #13), comment votre épistémologie peut-elle énoncer des généralités sur la pédagogie ?

- si vous pensez qu’il n’est pas éthique de mener des expérimentations en éducation (argument #16), pourquoi pensez-vous qu’il est éthique de soumettre les élèves à des pédagogies qui n’ont pas été testées expérimentalement ?

- Etc.

En résumé, on peut débattre de tout, y compris de l’épistémologie sous-jacente à l’éducation fondée sur des preuves. A condition que les détracteurs ne se contentent pas de critiquer, mais montrent concrètement comment leur épistémologie alternative produit des résultats aussi convaincants.

C. Arguments concernant la mise en œuvre

14. La singularité des contextes, des élèves… empêche toute mise en place de pratique fondée sur les données probantes

Oui, chaque élève est unique, et chaque enseignant est unique. Et pourtant, nous sommes tous des êtres humains, similaires par l’appartenance à la même espèce. Nous partageons tous l’architecture générale du cerveau humain que nous a légué l’évolution des primates, et donc nous partageons tous les mêmes mécanismes d’apprentissage, de mémorisation, de langage, de motivation, de cognition sociale, de régulation émotionnelle, et bien d’autres, qui sont impliqués dans les apprentissages scolaires.

De même, toutes les situations de classe sont uniques, mais elles ont toutes aussi de grandes similarités. Chaque année, en France, 800 000 élèves commencent à apprendre à lire, et les situations d’apprentissage de la lecture observées cette année diffèrent somme toute assez peu de celles observées l’année dernière.

Ainsi, malgré la singularité irréductible des individus et des situations, il existe aussi des régularités universelles, des généralités qu’il est possible d’extraire du bruit de fond. Et c’est tout l’objectif de la Science, que d’identifier les grands principes généraux qui gouvernent l’univers, les êtres vivants, et leurs relations, malgré le caractère unique de chaque instant, chaque endroit, et chaque être.

La validité et l’utilité de la compréhension scientifique du monde s’évalue à sa capacité à faire des prédictions correctes sur l’avenir : quelle sera la position précise de Pluton dans 24h, dans 1 an, dans 100 ans ? Ou sur le sujet qui nous intéresse : si l’année prochaine j’enseigne à mes élèves de CP la lecture par une méthode idéovisuelle, sauront-ils lire mieux ou moins bien (en moyenne) que mes élèves de cette année à qui j’enseigne par une méthode phonique ?

Le fait que les méthodes expérimentales en éducation soient capables de répondre de manière fiable à au moins certaines de ces questions d’intérêt primordial pour les enseignants, malgré la singularité incontestable des élèves, des enseignants et des situations, montre tout leur intérêt.

15. Les politiques éducatives échouent souvent à atteindre leurs objectifs, même quand elles sont fondées sur des preuves scientifiques

C’est vrai. C’est pour cela que l’on se préoccupe de plus en plus, au-delà des études expérimentales établissant des preuves d’efficacité de certaines pratiques ou politiques, de mener des études de passage à l’échelle en situation réelle. C’est un véritable défi, mais y répondre ne requiert pas de sortir du cadre de l’éducation fondée sur des preuves, au contraire, ça en fait partie. Et cela peut bien sûr se nourrir de toutes les études qualitatives ou quantitatives qui décrivent les conditions nécessaires pour l’adhésion et l’implémentation par les enseignants et les autres acteurs. Identifier les défis, les points de vigilance et d’amélioration ne doit donc pas conduire à rejeter l’approche fondée sur les preuves, mais à l’alimenter. Cela constitue même un sous-domaine à part entière, appelé « science de l’implémentation« .

16. Les enseignants doivent faire chaque jour des choix pédagogiques qui n’ont pas été testés scientifiquement, sans attendre les résultats des études

Bien sûr. La recherche scientifique a testé un certain nombre de pratiques pédagogiques, dans un certain nombre de contextes, et c’est déjà beaucoup. Mais c’est loin d’épuiser tout l’espace des pratiques pédagogiques et des situations de classe. En permanence, l’enseignant se trouve confronté à des lacunes de la recherche scientifique, et malgré tout il doit faire des choix et enseigner.

La question est donc : comment armer le mieux possible les enseignants pour affronter ces situations inédites et ces lacunes de nos connaissances pédagogiques ? Doit-on leur dire qu’ils peuvent bien ignorer les connaissances scientifiques existantes, parce qu’elles ne s’appliqueront jamais à leur situation ? Curieusement, personne ne recommanderait cela pour les médecins, qui, eux aussi, doivent faire face à des patients nouveaux et des maladies inconnues.

De la même manière que le « sens clinique » des médecins a d’autant plus de chances d’aboutir à un diagnostic correct et à un traitement efficace qu’il s’appuie sur des connaissances médicales solides, les « intuitions pédagogiques » des enseignants ont d’autant plus de chances d’être justes qu’elles s’appuient sur des connaissances solides des mécanismes des apprentissages et des pratiques efficaces, leur donnant les meilleures chances de transférer leurs compétences aux situations nouvelles.

Ainsi, il serait trompeur de croire que, sous prétexte que les études scientifiques répondent rarement aux questions précises que l’on se pose, et ne s’appliquent pas toujours aux situations que l’on rencontre, il serait inutile d’en prendre connaissance. Au contraire, une bonne maîtrise des connaissances scientifiques actuelles sur l’efficacité des pratiques pédagogiques et sur les mécanismes des apprentissages est la meilleure base que les enseignants puissent avoir pour inventer les pratiques qui répondent à leurs besoins dans leurs circonstances à eux.

L’argument est développé plus complètement dans la préface du livre L’apprentissage visible : ce que la science sait sur l’apprentissage.

D. Arguments éthiques, politiques et idéologiques

17. Il n’est pas éthique de procéder à des expérimentations en éducation, les élèves ne sont pas des cobayes

Si c’était vrai, il ne serait pas éthique non plus de procéder à des expérimentations sur des patients en médecine, qui ne sont pas des cobayes non plus. Or les conditions nécessaires pour procéder éthiquement à des expérimentations en médecine, y compris contre un groupe placebo, ont déjà été bien balisées depuis longtemps, et les mêmes arguments s’appliquent aisément dans les autres domaines.

Comme toujours, lorsqu’on critique une approche, il est important de la comparer aux situations alternatives, pour s’assurer qu’elles ne seraient pas encore pires. En l’espèce, si l’on se prive de recherches expérimentales permettant d’évaluer rigoureusement l’efficacité des pratiques en éducation, que se passe-t-il ?

On laisse les enseignants démunis, à la merci des modes, des idéologies et des arguments d’autorité, avec pour seul recours de tâtonner, de se baser sur leurs propres essais et erreurs, au détriment de leurs élèves, pour faire évoluer leurs pratiques. Autrement dit, on laisse chaque enseignant jouer au chercheur, sans pour autant lui donner une formation à la recherche ni les moyens de mener ses expérimentations et observations rigoureusement, et donc d’en tirer des conclusions valides. Le tout en dehors de tout cadre éthique. Dans ces conditions, ce sont tous les enfants qui sont les « cobayes » de tous les enseignants !

Refuser l’expérimentation en éducation pour des raisons prétendument éthiques, c’est maintenir volontairement les enseignants dans l’ignorance au lieu de se donner les moyens de guider rationnellement leur liberté pédagogique, c’est les laisser tâtonner perpétuellement à l’aveugle et reproduire des pratiques sous-optimales sur génération après génération de « cobayes ». Il est là, le véritable manquement à l’éthique.

18. L’éducation fondée sur des preuves évacue la question des valeurs

Oui, mais ce n’est pas une évacuation, c’est une indépendance de principe. En effet pour éviter de tout confondre, il serait sain de distinguer les objectifs et les moyens. L’éducation fondée sur des preuves ne s’occupe que des moyens. Les valeurs peuvent intervenir 1) dans la définition des objectifs ; 2) dans l’évaluation du caractère éthique des moyens.

Définir des objectifs éducatifs n’est pas le rôle des scientifiques. C’est le rôle des citoyens et de leurs représentants élus. Leurs valeurs (ce qui constitue une « bonne » éducation) jouent bien sûr un rôle important dans la définition de ces objectifs. L’éducation fondée sur des preuves ne se mêle donc pas de cela. Que les citoyens, les politiques, ou les enseignants disent ce qu’ils veulent obtenir ; l’éducation fondée sur des preuves pourra alors évaluer rigoureusement les différents moyens d’y parvenir. C’est tout ce qu’on lui demande et c’est déjà beaucoup !

Il se peut que, parmi les moyens établis comme les plus efficaces pour atteindre un objectif éducatif, il y ait des moyens que l’on juge non éthiques (relativement à certaines valeurs). A nouveau, c’est aux citoyens et à leurs représentants de faire le tri et de dire quels moyens leur semblent acceptables et lesquels doivent être écartés.

Bien sûr, les chercheurs de l’éducation fondée sur des preuves sont aussi des citoyens dotés d’une éthique, et peuvent s’apercevoir eux-mêmes si certains moyens posent problème et choisir de ne pas les évaluer ou de ne pas les promouvoir. Les comités d’éthique ont aussi pour mission d’empêcher les expérimentations de moyens non éthiques, ce qui fait qu’il est peu probable que de tels projets soient menés. Il existe donc des garde-fous éthiques au sein même de l’éducation fondée sur des preuves. Néanmoins, il est important, dans l’évaluation de toute politique ou pratique, de ne pas confondre l’évaluation de son efficacité et celle de sa conformité aux valeurs, qui sont deux choses conceptuellement différentes.

19. Vouloir évaluer l’efficacité en éducation, c’est du néolibéralisme

Dire cela, c’est confondre 1) une méthode scientifique pour évaluer l’efficacité des pratiques et des politiques publiques ; 2) certaines personnes ou politiques qui utilisent ou disent utiliser cette méthode ; et c’est ignorer tous les contre-exemples : les néolibéraux qui ne veulent pas d’évaluations d’efficacité, et les anti-libéraux qui en veulent. C’est aussi ignorer que toute préconisation pédagogique est motivée au moins implicitement par un présupposé d’efficacité : on le recommande parce que ça marche mieux. Même ceux qui rejettent l’évaluation d’efficacité s’y réfèrent donc implicitement.

En vérité, l’évaluation de l’efficacité des politiques publiques est une demande légitime de la part de tous les citoyens. Quelles que soient nos opinions politiques, nous avons tous intérêt à ce que les services publics fonctionnent de manière efficace en faisant le meilleur usage de nos impôts, y compris le service public d’éducation auquel nous confions nos enfants. Personne n’a intérêt à financer à fonds perdus des écoles où les élèves n’apprennent pas bien, pas plus que des hôpitaux où les patients ne sont pas soignés.

L’exigence d’évaluation rigoureuse des politiques publiques est donc politiquement totalement neutre. Et la connaissance scientifique de l’efficacité relative de différentes politiques éducatives et pratiques pédagogiques ne prescrit nullement la manière dont on doit s’en servir.

De fait, l’idée de liberté pédagogique sans contrainte est très compatible avec le néolibéralisme, avec le principe selon lequel les enseignants et les écoles font ce qu’ils veulent, les parents les jugeront sur leurs résultats, et la libre concurrence fera le reste. A l’inverse, un régime socialiste autoritaire pourrait bien être le plus enclin et le plus en capacité à vouloir utiliser cette connaissance pour imposer des pratiques uniformes à tous les enseignants.

Il s’agit là d’une nouvelle illustration du fait que les connaissances scientifiques peuvent être au service de toutes les politiques mais n’en prescrivent aucune en particulier. Vouloir assimiler les unes aux autres est une grave confusion.

19bis: « mais si, je vous dis, la montée de l’éducation fondée sur des preuves s’inscrit dans le contexte du New Public Management »

Dire que « X s’inscrit dans le contexte de Y », ce n’est rien de plus que l’observation d’une corrélation temporelle et spatiale. Ce n’est pas la preuve d’un effet causal ni d’un lien consubstantiel.

Mon interprétation de cette corrélation : il semble en effet y avoir concomitance entre 1) des progrès scientifiques et méthodologiques qui ont donné les moyens de mieux évaluer les effets des politiques publiques, et 2) l’arrivée au pouvoir d’un ou deux gouvernements qui souhaitaient réduire les dépenses publiques, qui ont trouvé là un moyen possible de le faire, et qui ont donc été les premiers à s’en servir.

Il n’en reste pas moins, comme je l’ai déjà expliqué, que quel que soit le niveau de dépense publique, tous les citoyens et tous les gouvernements ont intérêt à évaluer l’efficacité des politiques publiques, de manière à fournir les meilleurs services publics étant donné le montant des impôts consentis par les citoyens.

Je n’ai pas connaissance que qui que ce soit réclame de gaspiller l’argent de nos impôts dans des services publics inefficaces. Les opposants à l’éducation fondée sur des preuves réclament-ils cela ? Si leur réponse est non, alors ils veulent aussi une évaluation rigoureuse des politiques publiques, et leur discours est contradictoire avec leurs propres intérêts.

L’éducation fondée sur des preuves est politiquement neutre, elle produit de la connaissance qui peut être mise au service de toutes les politiques.

20. L’éducation fondée sur des preuves prend les enseignants pour des robots décervelés ou des techniciens

Cette croyance étrange provient sans doute de l’idée qu’évaluer et recommander des pratiques pédagogiques implique nécessairement d’avoir une conception très étroite et rigide de ces pratiques, qui ne laisserait aux enseignants aucun degré d’appréciation de la diversité des situations et aucun degré de liberté dans la mise en œuvre des pratiques.

Mais une telle idée est absurde et n’est soutenue par personne. Bien sûr, toute pratique pédagogique doit pouvoir être adaptée aux différents élèves et aux diverses situations, et cela n’empêche pas de pouvoir l’évaluer, puisque l’évaluation implique justement des expérimentations sur de grands groupes d’élèves dans des situations forcément diverses, qui auront déjà obligé les enseignants à s’adapter.

Personne n’imagine qu’un enseignant soit un exécutant aveugle d’une pratique rigide et uniforme, pas plus qu’un médecin ou un psychologue. Mais cela n’enlève rien à l’intérêt pour lui d’avoir une connaissance approfondie de différentes pratiques pédagogiques et de leur efficacité respective, et une bonne maîtrise des techniques et gestes professionnels requis par ces pratiques. Qu’il y ait une composante technique au métier d’enseignant n’est ni un problème, ni un déshonneur pour les enseignants, pas plus que pour les médecins ou les psychologues.

La nécessaire capacité à s’adapter à la diversité des élèves et des situations s’exercera d’autant mieux que l’enseignant pourra l’appuyer sur des connaissances solides et la maîtrise d’un éventail de pratiques à l’efficacité éprouvée.

21. L’éducation fondée sur des preuves veut formater les élèves, en faire de bons petits travailleurs dociles

Non, l’éducation fondée sur des preuves ne veut rien. Ce n’est qu’une méthode.

Je ne sais pas s’il existe vraiment des gens qui voudraient « formater » les élèves. Les personnes qui l’affirment n’en apportent aucune preuve, et cela ressemble bigrement à une théorie du complot. En tous cas, si des gouvernants voulaient cela, alors les méthodes expérimentales pourraient certainement déterminer les moyens les plus efficaces pour y parvenir. Encore faudrait-il que cela soit possible, et trouver des chercheurs pour mener de telles recherches.

Si des gouvernants veulent le contraire, par exemple former des citoyens libres et éclairés par des connaissances solides et un esprit critique affûté, alors les méthodes expérimentales peuvent également déterminer les méthodes les plus efficaces pour y parvenir.

Encore une fois, il est important de distinguer les objectifs de l’éducation et les moyens pour y parvenir. Les objectifs doivent être délibérés démocratiquement et conformes aux valeurs des citoyens. Une fois qu’ils sont définis, il est légitime de vouloir se donner les moyens les plus efficaces pour les atteindre. Car à quoi bon avoir de nobles valeurs et se fixer des objectifs merveilleux si l’on ne se donne pas les moyens de les atteindre ?

Les méthodes de l’éducation fondée sur des preuves peuvent aider à évaluer ces moyens et à choisir les meilleurs.

22. Ces recherches réduisent les enfants à leur cerveau. On enseigne à des enfants, pas à des cerveaux.

Je pense que cet argument s’adresse aux discours de type « neuroéducation », pas à l’éducation fondée sur des preuves. Or les deux sont entièrement indépendants. La plupart des pratiques évaluées dans le cadre de l’éducation fondée sur des preuves ne sont pas inspirées par les neurosciences, mais par les enseignants, les pédagogues, les observations en classe, ou encore par des connaissances en psychologie. Inversement, certaines pratiques inspirées par les neurosciences sont des neuromythes sans aucune preuve d’efficacité (par exemple le Brain Gym supposé stimuler les connexions entre hémisphères cérébraux). (pour en savoir plus sur ce que je pense de la neuroéducation)

Deuxièmement, je ne sais pas ce qu’est une recherche réduisant les enfants à leur cerveau. J’en ai demandé des exemples précis, et je n’ai plus eu aucune réponse.

Enfin, dire que l’on enseigne à des enfants, pas à des cerveaux, est un faux dilemme. Il n’y a pas à choisir entre les enfants et leurs cerveaux, puisque les deux sont indissociables, et puisque tout ce qu’on veut enseigner à un enfant doit nécessairement trouver une place dans son cerveau.

Dans cette vidéo je fais l’argument à propos de la mémoire, mais vous pouvez remplacer « mémoire » par « cerveau », c’est le même :

23. Promouvoir l’éducation fondée sur des preuves c’est entretenir le soupçon sur la façon dont les personnels font leur métier

Avec ce raisonnement on pourrait aussi bien dire « promouvoir la médecine fondée sur des preuves c’est entretenir le soupçon sur la façon dont les médecins font leur métier ».

On pourrait aussi dire « promouvoir la formation continue c’est entretenir le soupçon sur la façon dont les professionnels font leur métier ».

Dans quel métier n’a-t-on jamais besoin de mettre à jour ses connaissances et d’améliorer ses pratiques ?

Bravo et merci pour cette revue des arguments fallacieux contre l’EBE !

J’aimeAimé par 1 personne

Pas tout à fait rigoureuse cette analyse. Comment expliquez-vous , par exemple qu’une analyse poussée de statistiques et de données est parfaitement prédictive ? Par exemple les résultats de PISA sont parfaitement connus bien avant que les épreuves aient lieu…c’est le même constat pour les évaluations nationales ou même les résultats du bac qui sont finalement connus deux ans avant que les élèves aient mis les pieds au lycée…:)

J’aimeJ’aime

Je ne comprends pas ce que vous dites, ni le rapport que ça peut avoir avec cet article.

Puisque les résultats des évaluations nationales et internationales sont « parfaitement connus bien avant que les épreuves aient lieu », n’hésitez pas à nous donner ici et maintenant les résultats des évaluations nationales de l’année 2024-2025 (par exemple dites-nous pour chaque test si ça monte ou si ça descend par rapport à 2023-2024), et donnez-nous aussi les résultats de PISA 2025: est-ce que le score moyen des élèves français aura augmenté ou baissé? La Finlande aura-t-elle enrayé sa chute? L’Estonie aura-t-elle rebaissé?

Dites-nous tout, je veux tout savoir! Et donnez-moi les numéros du prochain Euro million, tant que vous y êtes.

J’aimeJ’aime

Il est assez fascinant qu’un texte qui se veut défendre la méthode scientifique ne cite strictement aucun contradicteur ni aucun argument de ces contradicteurs. Reformuler l’argument de l’autre, sans donner au lecteur la possibilité de vérifier si c’est bien ce qu’il dit, pour mieux le démolir n’est-ce pas précisément ce qu’on appelle l’homme de paille?

Cela fait un 23e argument à ajouter à la liste: les tenants de l’évidence basée éducation se situent en dehors du terrain de la production de discours scientifique en ce qu’ils se confrontent rarement à la réalité des critiques scientifiques sérieuses qui leur sont faites, ne les citent (presque) jamais et en réalité ne connaissent pas ces travaux et arguments, se contentant d’excommunier des caricatures qu’ils construisent eux mêmes.

C’est dommage car les critiques ne sont pas toute antiscientifiques et répondre vraiment aux arguments sérieux de collègues qui se tiennent sur le terrain de la science serait bien plus stimulant.

J’aimeJ’aime

Beaucoup d’arguments sont des copié-collé de ce que j’ai lu dans des articles, ou reçu sur Twitter et ailleurs. Je n’ai pas cité les sources des arguments pour ne stigmatiser personne, pour se focaliser sur les idées plutôt que de l’avoir l’air de faire des attaques ad hominem.

Si vous considérez que j’ai déformé les arguments de vos auteurs préférés, n’hésitez pas à relever le niveau du débat en restaurant la formulation exacte verbatim et en citant la source.

J’aimeJ’aime

Prenons par exemple cet entretien avec vous-même:

Fluckiger, C., Bernardo, L. M., Bart, D., & Lopo, T. T. (2023). Recherche en éducation et discours institutionnels sur l’École : Débats et approches critiques. Revista Lusófona de Educação, 59, 215‑231. https://doi.org/10.24140/issn.1645-7250.rle59.13

p. 218 vous citez Lima et Tual (2022): « même «des programmes ayant démontré empiriquement leur efficacité dans le cadre d’expérimentations à petite échelle extrêmement contrôlées produisaient des résultats nuls voir négatifs lorsqu’ils étaient implantés à grande échelle dans des classes tout-venant» ». C’est tout de même très proche de l’argument #14 « Les politiques éducatives échouent souvent à atteindre leurs objectifs, même quand elles sont fondées sur des preuves scientifiques ».

p. 224 vous dites: « le poids du contexte, la variété des contenus possibles à l’école, la gamme de difficultés des élèves sont tellement grands, que finalement on se retrouve avec des résultats qui n’ont que très rarement d’intérêt pour la mise en pratique dans les classes ». Si ce n’est pas l’argument #13, c’est donc son frère!

p. 226 vous dites: « il y a là une forme de réductionnisme de penser finalement que là où se joue l’apprentissage, c’est essentiellement au niveau neuronal ». Si ce n’est pas une variante de l’argument #21 « Ces recherches réduisent les enfants à leur cerveau. On enseigne à des enfants, pas à des cerveaux », qu’est-ce donc?

Bref, vous vouliez que je vous cite, alors je vous ai cité! Mais avouez que ça ne remet pas en cause ma formulation des arguments, bien au contraire.

Il y a dans votre article bien d’autres points critiquables. Je passe sur les critiques bon marché du CSEN (je vous mets au défi d’exhiber « plusieurs textes du CSÉN dont les références sont quasi-exclusivement à des travaux en neurosciences » p. 227).

Pour prendre un point substantiel, p. 224 je pourrais extraire un argument #23: « ce serait problématique de dire qu’on a des preuves, quand ce qu’on a c’est une description, une compréhension d’un processus ».

Comment pouvez-vous assimiler description à compréhension? Comment pouvez-vous affirmer avoir une compréhension, si vous n’en avez pas la preuve? Quand on a vraiment compris quelque chose, on doit pouvoir en fournir la preuve, pour s’en convaincre soi-même, et pour en convaincre les autres. Par exemple, en montrant que cette compréhension permet de faire des prédictions nouvelles, vérifiables et correctes. Quelles prédictions nouvelles, vérifiables et correctes votre « compréhension sans preuve » permet-elle de faire?

J’aimeJ’aime

Cher Franck

Pardonnez ce long message. En effet, lorsque je parlais de critiques « sérieuses » je n’avais pas la prétention de penser aux miennes, qui n’ont pas grand-chose de neuf, mais à l’excellent dossier Pratiques et Preuves dans la revue Education et Didactique (https://journals.openedition.org/educationdidactique/2717) , aux critiques de Chaptal sur les prétentions à déterminer l’efficacité des technologies (https://www.persee.fr/doc/stice_1952-8302_2009_num_16_1_993) ou de Baron et Depover ((2019). Les effets du numérique sur l’éducation : Regards sur une saga contemporaine. Presses universitaires du Septentrion.). Ou encore aux réflexion déjà anciennes de Bru (1998). La validation scientifique des propos et discours sur les pratiques d’enseignement : après les illusions perdues. In C. Hadji & J. Baillé (Dirs.), Recherche et éducation. Vers une nouvelle alliance. Bruxelles : De Boeck, p. 45-65 ou plus récemment de Bru, M. (2019). De quelques reconfigurations du rapport des recherches aux pratiques enseignantes. Les Sciences de l’Education. Pour l’ère nouvelle, n°1, Vol.52, p. 79-101.), de Livingstone (Livingstone, S. (2012). Critical reflections on the benefits of ICT in education. Oxford review of education, 38 (1), 9-24. http://eprints.lse.ac.uk/42947/).

Sur l’Evidence Based education, je pensais aux critiques de Saussez, F. et Lessard, C. (2009). Entre orthodoxie et pluralisme, les enjeux de l’éducation basée sur la preuve, Revue française de pédagogie, n°168. http://journals.openedition.org/rfp/1804 ou de Mialaret (https://www.cairn.info/revue-les-sciences-de-l-education-pour-l-erenouvelle-

2016-3-page-53.htm)

Je ne sais pas s’ils sont sur Twitter, peut-être vous ont-ils échappé…

Mais puisque vous m’avez fait l’honneur de lire un article (qui est en réalité une interview, d’où des tournures oralisées), je considère qu’il s’agit d’un début de discussion que j’espère fructueux.

Sur votre premier point, vous notez la proximité entre la citation que je donne de Lima et Tual et votre argument. Il peut sembler cocasse que ces auteurs se situent précisément dans le courant de l’Evidence Based Education et que la critique que vous voyez émane donc de ses défenseurs. En revanche, vous constaterez que ce que j’en dis est tout de même un peu différent du résumé que vous en faites : « On ne peut pas parler de bons outils ou de bonnes méthodes en éducation, en espérant que des méthodes ou des outils qui ont fait leur preuve en condition expérimentale pourraient être diffusés et repris tels quels par les enseignants. Dans le contexte réel de classe, les enseignants adaptent, modifient, réinterprètent, » et plus loin « il s’agit de montrer à quel point l’enseignement est une expertise, qu’il ne s’agit pas d’appliquer passivement une méthode dûment testée, qu’il ne s’agit pas seulement de donner un traitement qui a été validé scientifiquement auparavant par les chercheurs. Alors montrer cette part technique du métier, c’est aller à l’encontre de tous les discours d’autorité que nous avons aujourd’hui, et notamment ceux qui en appellent à ce qu’ils appellent une recherche translationnelle en éducation ». Je ne trouve pas que votre texte apporte une réponse.

Sur le point suivant, votre réponse est encore (de mon point de vue) à côté. Vous omettez de rappeler que je commence par apporter une pierre à votre édifice en disant : « Pour lever d’abord une ambigüité, les expérimentations randomisées contrôlées me semblent en effet être la méthode la plus aboutie pour obtenir des «preuves». C’est même souvent la seule méthode pour «prouver». Pour savoir si l’hydroxychloroquine fonctionne, il faut la tester par rapport à un placébo, et vérifier si l’une fonctionne mieux que l’autre, etc. Cela, seule l’expérimentation randomisée contrôlée peut l’apporter. » Mon point n’est pas celui là, c’est que « est-ce qu’en éducation, pour aider les praticiens, ce sont de preuves obtenues expérimentalement dont on a le plus besoin? Je n’en suis pas convaincu non plus! ».

Derrière cette idée il y a l’idée d’une rupture bachelardienne d’avec le sens commun, qui est systématiquement occultée dans ce genre de travaux mais qui est primordiale en science : la question de l’unité d’analyse pertinente. Il a été maintes fois argumenté que la « méthode » ou « l’outil » n’était pas des unités d’analyse pertinentes. Ce sont des notions de sens commun, non construites théoriquement. Je n’ai pas lu en retour de discussion théorique sérieuse sur la pertinence de ce que mesurent (avec toute la rigueur méthodologique que je vous accorde volontiers) les essais randomisés contrôlés en éducation sur la bonne méthode. Les sciences de la nature commencent par réfléchir à ce qu’elles mesurent, pourquoi pas l’éducation ? Si ce que l’on mesure n’a aucun sens, quelle est la validité des mesures?

Sur le réductionnisme, vous me faites un mauvais procès, puisque je n’ai pas assimilé EBE et neuroéducation, je réponds à une question sur le poids des neurosciences: c’est pour cela que j’en parle. Je ne fais d’ailleurs qu’enfoncer des portes ouvertes en rappelant que s’il s’agit de la base matérielle de l’apprentissage, l’apprentissage ne se donne pas en entier à voir par cette approche. Je crois qu’on sera d’accord sur ce point sans soucis, à moins que vous ne contestiez cela?

Par contre, vous me mettez « au défi » de citer des textes du CSEN dont les références sont quasi-exclusivement inscrites en neurosciences. Passons sur le ton un peu comminatoire du « défi », qui ne sied à mon avis pas tout à fait à un débat digne entre chercheurs, mais mettons : https://www.education.gouv.fr/csen-recommandations-pedagogiques-COVID19 ou https://liseo.france-education-international.fr/index.php?lvl=notice_display&id=47336. Vous y chercherez en vain la trace des riches débats entre chercheurs en éducation qui animent cette communauté de recherche depuis 50 ans (car rien n’est très neuf dans les approches que vous défendez). Les travaux importants sur la question ne sont jamais cités. En science, ne pas citer les critiques importantes est tout de même un sérieux problème: on peut être en désaccord, mais mettre la poussière sous le tapis est le contraire de l’attitude scientifique, consistant précisément à réfléchir collectivement aux limites de toute approche, toute méthode, tout paradigme. Ne pas le faire délibérément, c’est se tenir en dehors de la démarche scientifique et j’affirme, en pesant mes mots, que c’est ce que font bien des textes du CSEN, comme je l’ai argumenté dans un autre long article.

Enfin, lorsque vous reprenez ma phrase « ce serait problématique de dire qu’on a des preuves, quand ce qu’on a c’est une description, une compréhension d’un processus », vous vous étonnez : « Comment pouvez-vous assimiler description à compréhension? ». Comme vous le savez, il s’agit ici d’un entretien oral, d’où, sans doute, votre contre-sens complet : je n’assimile pas, je distingue au contraire, sans doute à l’écrit aurais-je dit plus clairement « description ou compréhension ». Là encore, je pense que vous manquez l’essentiel : ce que je dis va dans votre sens : je ne fais que rappeler qu’une preuve est quelque chose de précis en science. C’est ce que je dis dans la phrase précédente que vous avez tronquée : « Parce que prouver, c’est prouver des relations, des causalités, des liens… Pour le faire, il faut effectivement des méthodes rigoureuses. Et ce serait problématique de dire qu’on a des preuves, quand ce qu’on a c’est une description, une compréhension d’un processus. ». Je ne déteste rien davantage que ceux qui affirment avoir des preuves qu’ils n’ont pas, en astrologie, en pseudo-médecine ou en éducation. Si l’on est du côté de la science, comme je pense que nous le sommes tous deux, il est important de ne pas confondre les deux : comprendre un processus et lui donner une forme d’intelligibilité pour les acteurs et prouver des relations. Je maintiens que pour les praticiens, les deux peuvent apporter des éléments différents et dire, comme vous qu’une « compréhension permet de faire des prédictions » oublie de dire que comprendre les difficultés des élèves est déjà, pour les enseignants, un moyen de répondre à leurs problèmes. J’ai la faiblesse, pour bien connaitre le monde éducatif et les enseignants, que cela les aide souvent mieux que les « preuves » sur des « méthodes » qui de toute façon ne sont pas appliquées comme cela a été maintes fois montré. Mais je n’ai jamais pensé ou écrit que les preuves étaient inutiles. Les différentes disciplines scientifiques procèdent des deux et débutent souvent par une description minutieuse dont on ne peut faire l’économie, pas plus en éducation qu’en biologie ou en physique à l’époque de leur naissance en tant que discipline scientifique. Et bien sûr que la compréhension fine permet de faire des prédictions. Dans mon domaine je peux prédire les erreurs des élèves qui doivent programmer une boucle while par une analyse fine des difficultés épistémiques liées à cette notion et l’observation de leur activité, et je peux fournir sur cette base théorique et empirique des recommandations aux enseignants sur comment aider les élèves à les surmonter.

Il me semble que l’attention à cette distinction épistémologique entre prouver et comprendre vaut davantage de sérieux que votre ironie conclusive sur « ma compréhension sans preuve », car l’ironie n’invite guère à poursuivre la discussion (en tous cas ce serait alors sans moi).

J’aimeJ’aime

Désolé, les commentaires longs et/ou avec des liens font l’objet d’une modération automatique, il faut que j’aille les repêcher manuellement. Je pense avoir récupéré votre message principal qui contenait tout, mais dites-moi s’il manque quelque chose.

J’aimeJ’aime

ah je me demandais.. Merci à vous

J’aimeJ’aime

Sur les critiques académiques non citées: On est ici sur un blog de vulgarisation (et cet article a démarré sur Twitter), pas dans une revue scientifique. Je ne me fais donc pas une obligation de citer des sources académiques à la fin de chaque phrase, mais ça ne veut pas dire que je les ignore.

Vous pouvez lire ici un autre article, destiné à un support plus académique, dans lequel je cite quelques sources critiques.

Mais ce ne sont pas les mêmes que vous. Vous ne citez que des sources francophones, ce qui me semble être un cadre excessivement étroit. L’éducation fondée sur des preuves (et ses critiques) est un sujet mondial, il est donc normal que je cherche les parties de ce débat au niveau mondial, donc dans les bases bibliographiques internationales (en anglais). Ce faisant, je n’y ai évidemment pas trouvé les auteurs que vous citez.

J’ai tendance à considérer que s’ils ne s’adressent qu’aux 2% de francophones du monde, ils ne participent pas vraiment à ce débat mondial et peuvent donc être ignorés (voir cet article pour l’argumentaire complet sur publication en français vs. en anglais). J’ai peut-être tort, notamment si ces auteurs francophones que vous citez avaient un point de vue tellement original sur le sujet qu’on ne trouverait pas l’équivalent dans la littérature internationale. Est-ce vraiment le cas?

J’aimeJ’aime

Sur la formulation des arguments, il est certain que la mienne, volontairement concise, est forcément moins riche et nuancée que les paragraphes entiers que vous citez.

Pour moi, l’essentiel, ce n’est pas tant la manière dont j’ai résumé chaque argument, mais plutôt que la réponse que je leur apporte: est-ce qu’elle est suffisante ou pas? Convaincante ou pas (y compris du point de vue de la version complète de ces arguments)? C’est là que j’attends d’être contredit.

Par exemple, si on part de votre paragraphe ci-dessus autour de Lima et Tual, il me semble que toutes les réponses à y apporter se trouvent sous les numéros 13, 14 et 15. Que manque-t-il?

J’aimeJ’aime

Sur l’unité d’analyse pertinente: il n’y a pas une unité d’analyse privilégiée. Il peut être pertinent d’évaluer des micro-gestes pédagogiques, tout comme la politique éducative de tout un pays. Du moment qu’on sait de quoi on parle, qu’on peut mesurer les variables pertinentes avant et après, et comparer à une alternative, alors c’est possible. C’était le sens de ma réponse à l’argument #7.

Quant à la question de la mesure, de son sens, de sa validité, on se la pose tout le temps, comme dans toutes les autres sciences. Pourquoi en doutez-vous?

J’aimeJ’aime

Sur le poids des neurosciences, vous citez deux documents du CSEN. Vous leur reprochez de ne pas citer vos auteurs préférés. C’est probablement pour la même raison que je vous ai donnée ci-dessus: nous nous référons en priorité à la littérature internationale. En revanche, vous ne montrez nullement qu’ils font référence « quasi-exclusivement à des travaux en neurosciences ». Et pour cause, ils n’ont quasiment aucune référence en neurosciences!

J’aimeJ’aime

Sur la distinction entre compréhension et preuve, vous dites: « Dans mon domaine je peux prédire les erreurs des élèves qui doivent programmer une boucle while par une analyse fine des difficultés épistémiques liées à cette notion et l’observation de leur activité, et je peux fournir sur cette base théorique et empirique des recommandations aux enseignants sur comment aider les élèves à les surmonter. »

Ce que je comprends que vous décrivez, c’est que vos observations vous donnent un sentiment de compréhension et vous amènent à faire des prédictions. Mais ce ne sont là que des hypothèses. Avant de faire des recommandations aux enseignants, ne conviendrait-il pas de les tester? C’est-à-dire évaluer quantitativement la justesse de vos prédictions, et la capacité de vos recommandations à faire progresser les élèves?

J’aimeJ’aime

Ceux qui critiquent les données probantes n’ont que de la rhétorique et absolument rien de plus rigoureux et de mieux à proposer! Le fardeau de la preuve apparaît à ceux qui s’opposent! Montrez-nous mieux? Show me the data!

J’aimeAimé par 1 personne

Ou l’art de s’enfermer soi-même dans son propre piège.

Vous dites « Le fardeau de la preuve apparaît à ceux qui s’opposent! » Vraiment??? I beg to differ. En justice comme en science, le fardeau de la preuve revient à celui qui affirme quelque chose, ou alors toute l’épistémologie s’effondre et je peux affirmer que les licornes existent : si le fardeau de la preuve revient à ceux qui pensent qu’elles n’existent pas, bon courage pour le démontrer.

Vous affirmez que l’EBE améliore l’éducation? Fort bien, « show me the data » comme vous dites si bien. Quelle sont les données qui montrent que l’EBE améliore l’éducation, ou au moins qu’elle l’améliore davantage que des recherches qualitatives?

Et pour vraiment rigoler, si vous avez de telles « preuves » (et là je vous attends fermement), ont-elles été obtenues par une méthode RCT, la seule méthode vraiment scientifique selon vous? Publiée dans une revue de premier ordre?

Si non… pourquoi devrions nous suivre des critères que vous promouvez mais que vous n’appliquez pas à vous même? Sans ces « preuves », indispensables selon vous pour les autres mais pas pour vous, en quoi votre idée que seule votre démarche améliore l’éducation est plus qu’un dogme sans étayage?

J’aimeJ’aime

Je suis tout à fait partisan de l’éducation fondée sur des preuves. Néanmoins (du moins dans la matière que j’ai enseignée), il me paraît très difficile de la mettre en application car il me semble que la maîtrise de la langue maternelle au-delà de quelques étapes identifiables ne fonctionne pas par degrés mais par synthèse.

C’est évidemment une sorte d’escalier mais on ne monte pas une marche après l’autre, une marche peut être inconnue et on passe quand même à la suivante. Le fait que l’on sache conjuguer au présent n’est pas prédictif qu’on saura conjuguer à l’imparfait et parfois c’est en assimilant plus tard l’imparfait qu’on saura conjuguer au présent.

Inversement, le fait que l’on soit capable de décoder correctement n’est pas prédictif qu’on saura décoder un sens. Il n’y a pas vraiment de suite logique et attendue mais plutôt une progression spiralaire qui n’obéit pas à des étapes précises.

La conséquence est qu’en dehors d’un savoir synthétique que l’on teste (ex l’étendue d’un lexique mais sur des milliers d’item pas seulement sur une dizaine), il est très difficile d’administrer une vraie preuve d’efficacité.

S’ajoute un élément capital concernant la mémoire elle-même et la plasticité du cerveau : Un test ou plusieurs tests s’inscrivent dans des moments T mais le cerveau s’en moque complètement. Son assimilation est plus lente et imprévisible. Il y a des connexions paradoxales qui font que ce qui était savoir inerte redevient vivant ou l’inverse. Tout cela me semble fonctionner par inhibition et stimulation avec des variations incroyables du moins dans le temps long.

En somme, ma modération sur l’idée de preuve appliquée à l’éducation concerne :

1/ les tests assez peu fiables car portant sur une petite quantité.( ex : pour l’étendue d’un lexique, à l’inverse, il s’agit de milliers mots sur programme informatique à traiter en temps limité)

2/ ils sont d’autant moins fiables qu’il faudrait les répéter avec les mêmes élèves, dans les mêmes conditions de passation pendant des années pour évaluer le degré d’implantation de ces connaissances. Parfois, elles sont automatisées parfois non. Parfois, elles sont associées à d’autres connaissances et renforcées, parfois, elles sont comme des îlots stériles.

En conclusion, je dirais qu’une preuve n’est qu’une preuve actuelle non inscrite dans le temps long et que l’éducation est affaire de temps long et qu’elle ne touche qu’un segment de la connaissance qui n’est pas nécessairement déterminant pour la suite.(je parle pour le français) car c’est un savoir qui ne fonctionne pas par degrés qui s’enchaînent mais par synthèse le plus souvent imprévisible.

En histoire, vous pouvez tout connaître sur la Révolution française et rien sur les Mérovingiens. En Français, on peut mettre en oeuvre des connaissances dont on n’a même pas conscience, écrire correctement sans savoir qu’on applique telle ou telle règle. Les marches de l’escalier ont même disparu.

J’aimeJ’aime

Le consensus scientifique paraît être le degré le plus élevé de preuve.

Mais je me pose une question. Existe-t-il des études sur la classe de terminale ? C’est la classe de sortie du système scolaire et en principe d’entrée en faculté. Les résultats sont tout à fait excellents 90% des élèves en moyenne obtienne ce sésame.

Et ce que j’aimerais savoir si lors des tests (s’ils ont existé, bien sûr) on a pu déceler des lacunes relevant du collège ou même de l’école primaire qui en bonne logique auraient dû les empêcher d’obtenir cet examen.

Car si, on a pu constater de telles lacunes, plusieurs hypothèses en découlent :

1/ les programmes qui indiquent d’une manière très précise les rythmes d’acquisition en fonction des classes et prétendent établir un certain nombre de conditions (si on ne sait pas ceci, on ne peut parvenir à cela) et une progression linéaire seraient inadéquates car non révélateurs de l’issue.

2/ le niveau des élèves ne correspond pas aux exigences du bac et nous avons affaire à une politique des quotas qui fonctionne par indulgence et aveuglement volontaire.

Cette dernière hypothèse correspondrait bien à ce que constate les tests externes à l’éducation nationale (type OCDE) .

En effet, étant donné le niveau en sixième et à quinze ans, comment les élèves ont-ils pu, en très peu de temps, rattraper un retard significatif en maîtrise de la compréhension ou en mathématiques ?

Si de tels tests en terminale existent, j’aimerais bien en avoir la référence car il y a comme un paradoxe entre le succès massif en sortie des élèves et leur échec provisoire dans certaines classes pourtant décisives.

J’aimeJ’aime

Bonjour,

Vous oubliez quelque chose : Entre la classe de sixième et la classe de terminale, ce ne sont plus les mêmes élèves. Le nombre d’élèves qui va jusqu’au bac a augmenté ces dernières décennies mais un certain nombre d’élèves de sixième, très probablement les plus en difficultés, ne vont pas jusqu’en terminale.

J’aimeJ’aime

Bonjour,

Vous avez tout à fait raison. Je ne connais pas les chiffres exacts mais il y a environ 100000 jeunes qui sortent chaque année sans qualification d’aucune sorte.(Actuellement, peut-être 80000.)

On peut supposer que certains d’entre eux (je ne sais pas non plus leur nombre) vont bénéficier d’une formation hors système scolaire : apprentissage, remise à niveau etc.

Il n’en reste pas moins que les lauréats des différents bacs – général, technologique ou professionnel – représentent plus de 5OOOOO personnes et que beaucoup d’entre eux vont à l’université ou en BTS.

Les professeurs d’université, quelle que soit leur discipline, se plaignent de la faiblesse du niveau en particulier en maîtrise de la langue.

Par ailleurs, Il doit y avoir la moitié de mentions au bac. Les jurys jugent donc que les élèves sont au niveau. Il y a donc bien quelque chose qui ne va pas :

1/ trop d’élèves abandonnent l’école d’une manière prématurée.

2/ Ceux qui réussissent le bac ont des difficultés alors que le bac est le premier degré de l’université et pas seulement un diplôme de fin d’étude.

Je ne sais plus si le rendez-vous citoyen ou son équivalent existe encore mais l’armée constatait un grand nombre d’illettrés ou de jeunes ayant des difficultés…même parmi ceux qui ont eu une scolarité considérée comme normale.

Autre fait assez révélateur de l’échec actuel de l’enseignement, de très nombreux prisonniers sont illettrés.

Je rappelle que l’enseignement ou l’instruction est en France obligatoire jusqu’à 16 ans, de quoi, en principe, apprendre largement à lire, même si cette faculté peut se détériorer faute de pratique ou pour d’autres raisons.

Les dyslexies de développement touche environ 5% de la population. Mais il me semble qu’il y a une sorte de « dyslexie acquise » pour de trop nombreux élèves qu’il ne faut pas, bien sûr, confondre avec les premiers.

Cela tient moins, me semble-t-il, aux méthodes d’apprentissage qu’à un apprentissage insuffisamment continué.

Des recherches citées par le Pr Ramus indiquent que vers 11 ans le bénéfice des méthodes phoniques s’estompent.

Non, le problème n’est pas celui de l’entrée en lecture mais plus tard en CM1 le refus de passer d’un décodage phonique à un décodage ortho-sémantique qui s’appuie sur un apprentissage systématique et systémique du lexique qui seul permet une compréhension fine et l’accès à des textes de haut niveau (ce qui devrait être le cas en Terminale)

J’aimeJ’aime

En ce qui concerne la mémoire existe-t-il des travaux sur son efficacité (notamment à long terme) dans son rapport avec l’étendue et l’organisation du vocabulaire ?

Avec le questionnaire suivant :

1/ si on augmente le lexique d’une manière structurée, y a t-il une amélioration des performances de la mémoire ou d’ailleurs des mémoires (épisodique, perceptive etc; ) ? La compréhension permettant une augmentation des connaissances et des compétences ?

2/ si oui, à partir de combien de mots et de concepts ( des centaines ? Des milliers ? Et lesquels en particulier ?)

3/ Les personnes ayant un vocabulaire très étendu et organisé ont-elles une meilleure mémoire ?

4/ les pertes mnésiques commencent-elles par une perte de vocabulaire ? En particulier dans le rappel libre ou indicée ?

Petite parenthèse « véhément » n’a jamais voulu dire « passionné » mais violent (cf les 16 mots de la vidéo). Je me suis d’ailleurs arrêté à la première question. La passion est une qualité, la véhémence, un défaut. C’est un mot « péjoratif. » Lorsque l’on veut définir un mot, il faut éviter la contamination par d’autres mots qui en atténuent ou en occultent le sens. A ce titre, une phrase non neutre peut empêcher la compréhension d’un mot car elle crée des ambiguïtés. Si j’ose dire, un mot dans une phrase a toujours une marge de manoeuvre qui l’éloigne du sens original. En tout cas, » Il a été véhément dans son propos » n’a jamais voulu dire : « Il a été passionné » mais « violent », « excessif, » voire « agressif. »

Le premier devoir d’un test c’est quand même d’être fiable.

J’aimeJ’aime

Passionnante conférence sur la lecture qui établit que les méthodes phoniques d’apprentissage sont supérieures aux non-phoniques.

Néanmoins dans une étude, on constate qu’à 11 ans cette supériorité semble décliner. C’est le point le plus important. A 11 ans, la lecture ne ressemble plus du tout à ce qu’elle était en CP. L’exigence de compréhension est beaucoup plus forte.

Nous avons changé de dimension et si l’on ne fait pas à partir du CM1 ce que j’appelle du décodage sémantique et orthographique avec un enrichissement systémique du lexique…on aura ce que l’on constate à l’heure actuelle : 4O% des élèves en sixième ont une mauvaise compréhension de l’écrit à cause entre autre d’une mauvaise reconnaissance orthographique des mots.

Cette lacune va s’accroître, plus le niveau va augmenter lui-même, si bien qu’un dégoût de la lecture va s’instaurer puisque n’importe quel livre d’un certain niveau lexical va devenir incompréhensible, la charge mentale étant alors trop grande et le plaisir inexistant.

Encore une fois, ce qui compte, ce n’est pas l’apprentissage de la lecture au départ mais, par la suite, l’apprentissage systématique et systémique du lexique…. et cela ne coûte rien…sauf des manuels ad hoc avec des algorithmes précis.

En somme, lorsqu’on parle « d’échec de la lecture », on se trompe de sujet. Le point capital c’est la constitution d’un lexique orthographique et sémantique dit interne qui est malheureusement totalement négligé avec le préjudice que l’on sait.

J’aimeJ’aime